亲社会实验室 | 关于自动驾驶中的道德伦理问题

Coco有话说

随着科技的发展,“无人车”也逐步进入公众的视野。未来的人类生活,当自动驾驶成为常态,我们不禁会好奇,车辆自身在驾驶过程中会有道德判断吗?遇到两难问题时它会做出怎样的选择呢?例如,一辆即将发生事故的自动驾驶汽车,该不该转动方向盘撞向一名乱穿马路的青少年,以避免使三名年迈的乘客伤亡吗?

道德两难指的是同时涉及两种道德规范,使行动者面临两者不可兼得的情境时的困境,例如经典的“电车难题”等就是人们在社会生活中经常遇到的道德两难困境。自动驾驶汽车的设计也不可避免地会遭遇此类问题,因此,确定无人车的伦理原则不能仅凭工程师或伦理学家来决定,也需要考虑到所有用户乃至全人类的主观想法和道德判断。

《自然》(Nature)于2018年10月发表了一篇文章,试图探讨这一问题。研究者们通过一款名为“道德机器”(Moral machine)的多语种在线游戏,收集了跨国大规模实验数据,考察人们在不可避免的事故背景下,会希望自动驾驶汽车如何解决道德两难问题,并以此投射世界各地的人们有关道德判断方面的差异。道德机器最终收集了来自233个国家(地区)的3961万个用户的数据。

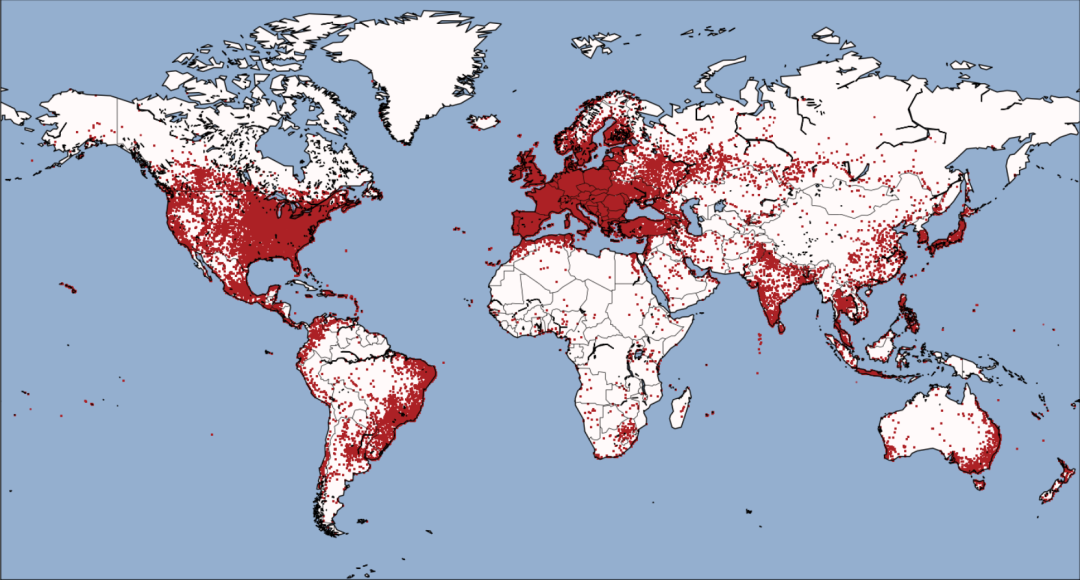

图1 参与道德机器游戏的用户在世界地图上的分布情况(N = 39.6 million)

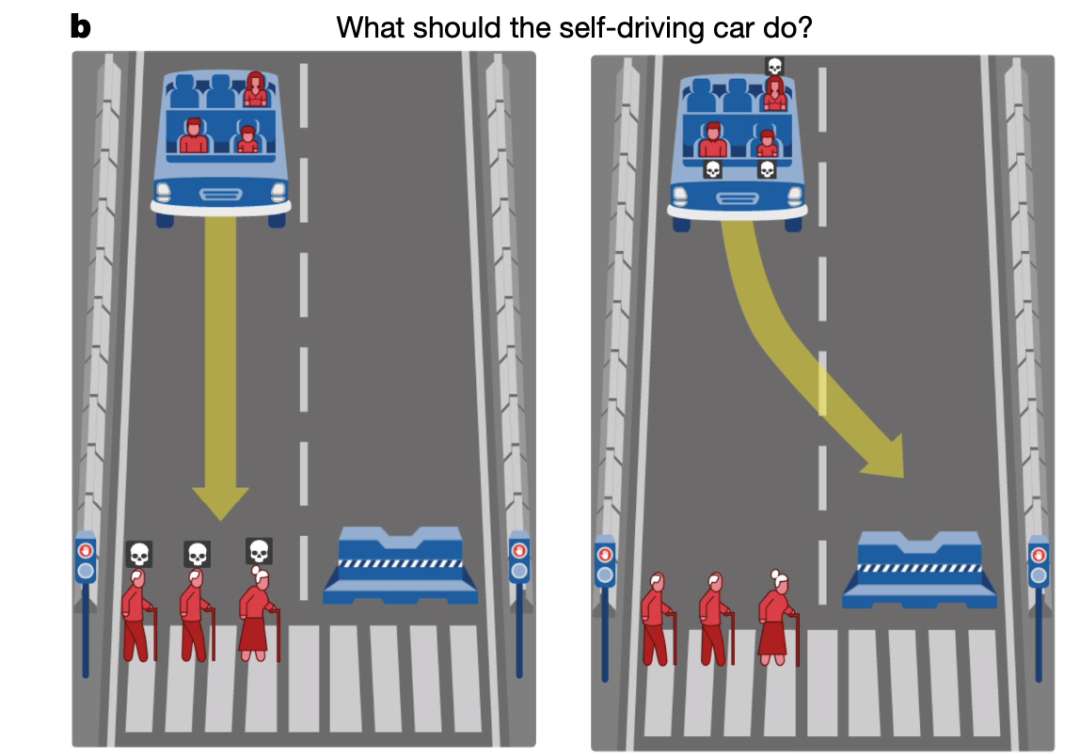

道德机器游戏的玩法非常简单,用户会在主界面上看到一场无法避免的交通事故,用户仅需要选择让无人车转向还是继续保持原有航线行驶即可。

而用户的不同选择会改变交通事故的结局。以图2所示举例,无人车上有三名年轻的乘客,但车子的刹车片坏了,如果车子继续向前行驶就会撞向三名老人,但转动方向盘则会导致三名年轻乘客的死亡。类似的交通意外场景还有:车上是人类,而斑马线上是动物;斑马线上的人数大于车内乘客人数;斑马线上的人正在违反交通规则闯红灯等等。用户在完成了面临13次意外事故的选择后,还要填写一项调查,包括用户性别、年龄、收入和教育水平等人口统计信息,以及宗教倾向和政治态度。最后,研究者对所有参与者进行了地理定位,以便将参与者的坐标用于聚类分析——确定是否来自地理上相似的国家或地区的人群具有相同或类似的道德偏好。

图2 道德机器主界面展示图

结果发现,首先,全球范围的数据显示,人们在道德机器上存在道德偏好。人们在道德两难的困境下更倾向于拯救人类而非动物;拯救更多的生命而非更少的生命;拯救年轻人而非老年人。且用户本身的性别、年龄、收入和受教育水平等人口学特证均对该结果没有影响。

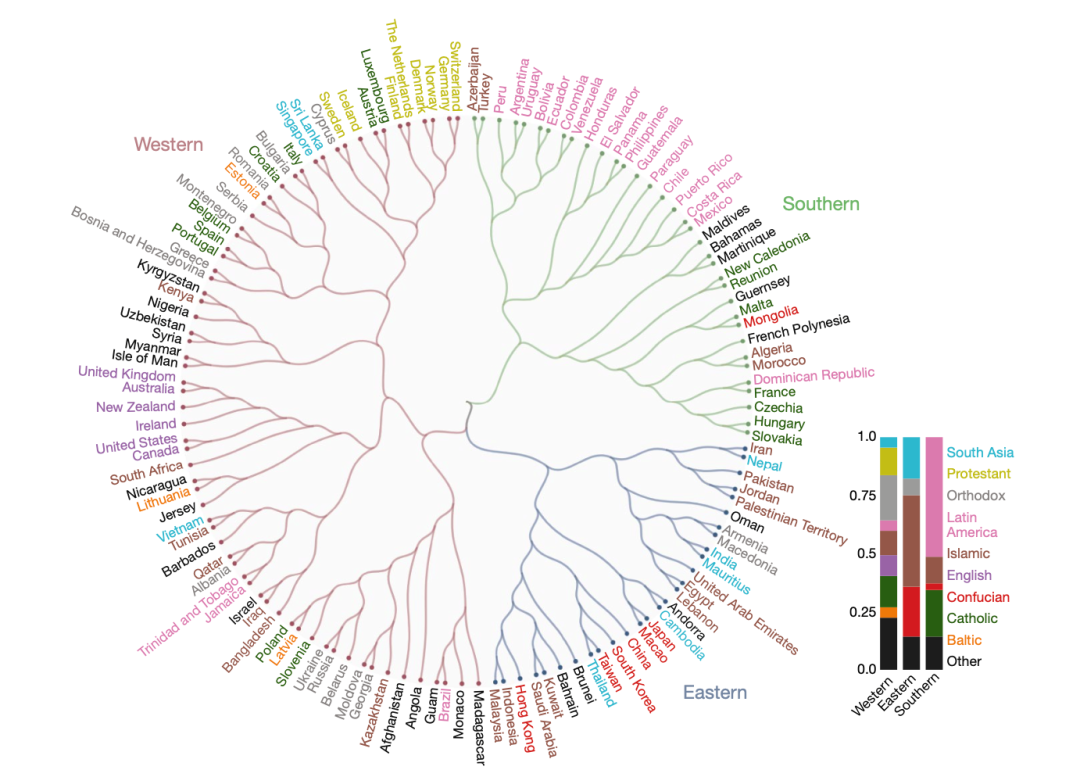

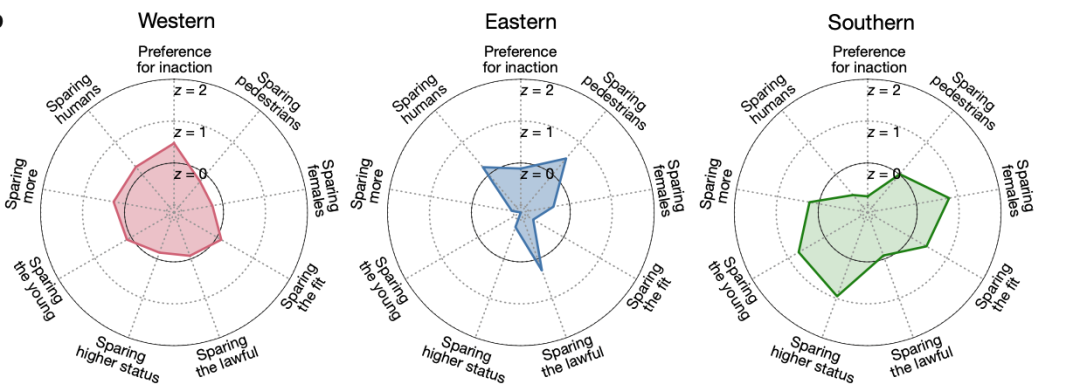

其次,研究者通过聚类分析识别出了三种不同类型的国家或地区,即西方聚类(Western cluster)、东方聚类(Eastern cluster)和南方聚类(Southern cluster)(见图3)。即使全世界用户在道德两难困境下道德判断倾向结果稳定,但不同国家或地区内依旧存在一定道德判断的差异。由图4可以看出,西方聚类国家中的人群更倾向拯救多数人、拯救年轻人和拯救更健康的个体。而东方聚类国家或地区中的人群却并没有拯救年轻人的偏好。与此同时,南方聚类国家中的人群对拯救女性的偏好非常强烈。由此可见,地理和文化上的接近可能会让不同地区的群体在道德判断上有共同的偏好。

图3 道德机器国家或地区层面聚类结果

图4 三种聚类在道德机器不同维度的道德偏好雷达图(红色-西方;蓝色-东方;绿色-南方)

第三,通过分析国家之间的经济情况和文化氛围发现,道德机器揭示的偏好与国家之间的文化和经济差异高度相关。从文化角度看,一个国家在文化上与美国越相似,其个体在道德机器偏好上也越相似。例如,个体主义国家的人相比于集体主义国家(地区)的人更偏好挽救多数人而不是少数人。而集体主义国家(地区)的人则在挽救年轻人还是挽救年长人方面没有明显偏好。从经济角度看,经济越发达的地方,人们越不容忍违反规则的现象发生,更会倾向于牺牲掉那些违反交通规则的人。而在经济越不平等的地方,人们对待穷人和富人的道德偏好上差距越明显,人们更倾向拯救富人而非穷人。但几乎所有的国家中都表现出拯救女性而非男性的道德偏好,而这种道德偏好在女性生存前景更好的国家中会更加强烈。

综上,本研究通过九维度的道德两难实验设计,发现了全球人群面临无人车发生意外时,在道德两难情境下的普遍性道德判断偏好。研究者不仅对国家之间进行了聚类,还探究了文化、经济以及人口特质对道德判断偏好的影响。

尽管该研究设计的实验情境是强制二分情境,样本收集并非抽样设计而是由玩家自主选择参加,没有考虑乘客与行人之间的社会关系情况等等,以至于无法公正地解决自动驾驶汽车困境的所有复杂问题。但无可否认,该研究对道德判断以及未来无人车领域如何设定道德两难情境选择项具有深远且重要的意义。

在人类历史上,人类从未允许一台机器在不到一秒钟的时间内,在没有实时监督的情况下,自主地决定谁应该生谁应该死。但现在,就在我们未来最日常的交通生活中,这一景象将触手可及。因此,在用户允许自动驾驶汽车做出道德决策之前,研究者乃至每个普通人需要进行一次心灵对话,究竟应该做出怎样的道德选择?这不仅对设计道德算法的公司有意义,更重要的是,这对社会政策制定者也具有重要意义。

参考文献:

Awad, E., Dsouza, S., Kim, R. et al. The Moral Machine experiment. Nature. 563, 59–64 (2018).

https://doi.org/10.1038/s41586-018-0637-6

推文作者:林靓

插图:刘彦伯

编辑:刘彦伯

排版:彭重昊